À l’ère du numérique, la gestion des données est devenue un enjeu majeur pour les entreprises. Les 5 V du big data représentent les piliers fondamentaux qui permettent de comprendre et d’exploiter efficacement les données massives. Cette approche méthodique aide les organisations à transformer le déluge d’informations en insights précieux pour leur activité. Que vous soyez débutant ou expert en analyse de données, maîtriser ces cinq dimensions est essentiel pour réussir dans un monde où la data est au cœur de toutes les décisions stratégiques.

Comprendre les 5 V du big data

Les 5 V du big data sont les caractéristiques essentielles qui définissent ce domaine : Volume, Variété, Vitesse, Véracité et Valeur. Ces dimensions aident à comprendre pourquoi le big data est différent des méthodes traditionnelles d’analyse de données. Chaque “V” représente un défi particulier mais aussi une opportunité pour les entreprises qui cherchent à exploiter la puissance des données massives. Comprendre ces 5 aspects est crucial pour toute organisation qui souhaite tirer profit du potentiel du big data dans notre monde numérique en constante évolution.

Le volume

Le premier V du big data est le volume gigantesque des données traitées. Il s’agit d’ensembles de données tellement énormes qu’ils sont mesurés en pétaoctets ou même en exaoctets – des chiffres difficiles à imaginer ! Pour vous donner une idée, un pétaoctet équivaut à 1 million de gigaoctets. Ces quantités massives de données proviennent de sources variées comme les réseaux sociaux, les appareils connectés, les capteurs industriels et les dossiers électroniques.

Les entreprises doivent maintenant gérer ce déluge de données qui grandit chaque jour. Pour faire face à ce volume, elles utilisent souvent des infrastructures cloud comme AWS, Azure ou Google Cloud, qui permettent un stockage et un traitement évolutifs. Le big data nécessite des outils spéciaux comme Hadoop ou Spark, car les méthodes traditionnelles ne peuvent tout simplement pas gérer de telles quantités d’informations.

La variété

Le deuxième V concerne la diversité des types de données que les systèmes doivent traiter. Dans le monde du big data, les informations se présentent sous de nombreuses formes différentes : données structurées (comme celles des bases de données classiques), semi-structurées (comme le XML ou JSON) et non structurées (textes, images, vidéos, enregistrements audio).

Cette variété représente un vrai défi technique. Par exemple, comment comparer une photo publiée sur Instagram avec un commentaire textuel sur Twitter et des données de géolocalisation ? Les 5 V du big data nous rappellent qu’il faut des outils spécifiques pour donner du sens à cette diversité. Des techniques avancées d’analyse sont nécessaires pour extraire des informations utiles de ces formats disparates et les transformer en connaissances exploitables.

La vitesse et la véracité des données

La vitesse

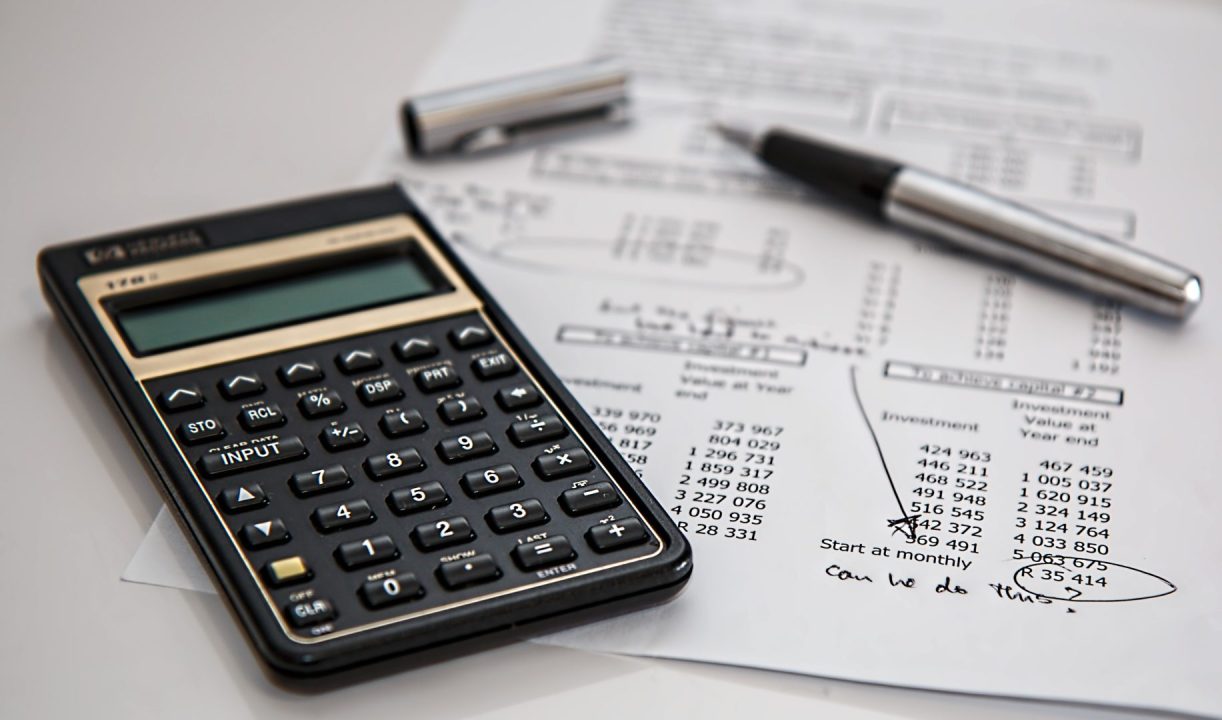

Le troisième V du big data est la vitesse impressionnante avec laquelle les données sont créées, transmises et traitées. Aujourd’hui, les informations circulent en temps réel ou quasi-réel. Pensez aux transactions bancaires, aux capteurs industriels ou aux publications sur les réseaux sociaux qui génèrent des données en continu, 24 heures sur 24.

Cette rapidité offre des avantages considérables. Par exemple, Netflix utilise l’analyse en temps réel pour recommander du contenu personnalisé à ses utilisateurs. De même, les institutions financières peuvent détecter des fraudes presque instantanément, avant même que les transactions suspectes ne soient terminées. La capacité à analyser rapidement ces flux de données représente un avantage concurrentiel majeur dans notre économie numérique où chaque seconde compte.

La véracité

Le quatrième V concerne la fiabilité et la qualité des données. C’est probablement l’un des aspects les plus délicats des 5 V du big data. Toutes les données ne se valent pas : certaines sont précises et fiables, d’autres contiennent des erreurs, des incohérences ou des biais. Dans le monde médical ou financier, se fier à des données inexactes peut avoir des conséquences graves.

Pour garantir la véracité, nous conseillons aux entreprises de mettre en place des processus rigoureux de validation et de nettoyage des données. Il est essentiel d’évaluer la source des informations, d’éliminer les doublons et de corriger les erreurs. Environ 91% des dirigeants mondiaux considèrent que des stratégies efficaces d’analyse de données sont essentielles à la croissance de leur organisation – mais ces stratégies ne fonctionnent que si les données sont fiables.

La valeur des données dans le big data

Le cinquième et dernier V représente la valeur commerciale que les entreprises peuvent tirer de l’analyse des données massives. C’est l’objectif final de tout projet big data : transformer ces montagnes d’informations en connaissances utiles qui aident à prendre de meilleures décisions. La valeur peut se manifester de différentes façons : amélioration de l’expérience client, optimisation des processus, réduction des coûts ou création de nouveaux produits et services.

Amazon est un excellent exemple d’entreprise qui extrait efficacement de la valeur du big data. Grâce à l’analyse des comportements d’achat, des recherches et des préférences des utilisateurs, l’entreprise peut personnaliser les recommandations, optimiser les prix et prévoir la demande pour chaque produit. Cette capacité à transformer les données en insights exploitables explique en grande partie le succès d’Amazon dans le commerce en ligne. La valeur est vraiment l’aboutissement des quatre autres V – sans elle, le big data ne serait qu’une accumulation coûteuse d’informations sans utilité pratique.

| V du big data | Description | Exemple d’application |

|---|---|---|

| Volume | Quantité massive de données (pétaoctets, exaoctets) | Stockage cloud (AWS, Google Cloud) |

| Variété | Diversité des formats (structurés, non structurés) | Analyse de textes, images et vidéos |

| Vitesse | Rapidité de génération et traitement | Détection de fraude en temps réel |

| Véracité | Fiabilité et qualité des données | Processus de validation et nettoyage |

| Valeur | Bénéfices commerciaux tirés des données | Personnalisation des recommandations |

L’importance des 5 V du big data pour les entreprises

Comprendre les 5 V du big data est devenu crucial pour les entreprises de toutes tailles et de tous secteurs. Cette connaissance permet d’abord de mieux planifier les infrastructures techniques nécessaires pour collecter, stocker et analyser efficacement les données. Les organisations qui maîtrisent ces concepts peuvent développer des stratégies data-driven plus pertinentes et prendre des décisions basées sur des faits plutôt que sur des intuitions.

Les entreprises qui excellent dans la gestion des 5 V obtiennent des avantages concurrentiels significatifs. Elles peuvent mieux connaître leurs clients, personnaliser leurs offres, optimiser leurs opérations et même prédire les tendances futures. Par exemple, les institutions financières utilisent le big data pour détecter les fraudes en temps réel, tandis que les détaillants analysent les habitudes d’achat pour optimiser leurs stocks. Nous recommandons aux organisations d’investir dans la formation de leurs équipes aux concepts et outils du big data, que ce soit via des MOOCs spécialisés ou des certifications professionnelles. Cette connaissance devient aussi importante que la maîtrise d’Excel l’était il y a quelques décennies.

Conclusion

Les 5 V du big data – Volume, Variété, Vitesse, Véracité et Valeur – forment ensemble un cadre essentiel pour comprendre les défis et les opportunités des données massives. Ces dimensions sont interconnectées : un grand volume de données variées, traitées rapidement et de manière fiable, peut générer une valeur commerciale considérable.

À mesure que notre monde devient de plus en plus numérisé, la quantité de données continuera d’augmenter de façon exponentielle. Les entreprises qui sauront naviguer efficacement dans cet océan d’informations en comprenant et en maîtrisant les 5 V du big data seront celles qui réussiront le mieux à l’avenir. Que vous soyez une petite entreprise ou une multinationale, les principes restent les mêmes : collecter les bonnes données, les analyser intelligemment et les transformer en actions concrètes. C’est là que réside le véritable pouvoir du big data.

FAQ

Quels sont les 5 V du Big Data ?

Les 5 V du Big Data sont le Volume, la Variété, la Vitesse, la Véracité et la Valeur. Ces caractéristiques permettent de distinguer le Big Data des méthodes traditionnelles, en soulignant les défis et opportunités qu’il présente pour les entreprises.

Quels sont les 5 facteurs du Big Data ?

Les 5 facteurs du Big Data incluent l’infrastructure technique, la gestion des données, l’analyse, la sécurité des données et la régulation. Ces facteurs sont essentiels pour permettre aux entreprises d’exploiter efficacement leurs données massives et d’en tirer des insights significatifs.

Quelles sont les 7 V du Big Data ?

Les 7 V du Big Data comprennent le Volume, la Variété, la Vitesse, la Véracité, la Valeur, la Variabilité et la Complexité. Chaque “V” représente un aspect clé qui aide les entreprises à naviguer dans le paysage sophistiqué de l’analyse des données massives.

Quelles sont les 5 caractéristiques principales du Big Data ?

Les 5 caractéristiques principales du Big Data incluent un grand volume de données, la diversité des sources de données, une vitesse de génération rapide, l’importance de la véracité et la capacité à extraire de la valeur. Ces caractéristiques sont essentielles pour maximiser le potentiel du Big Data.

Comment le Big Data peut-il aider les entreprises à améliorer leur prise de décision ?

Le Big Data peut aider les entreprises à améliorer leur prise de décision en fournissant des insights basés sur des données analytiques. L’analyse des données massives permet d’identifier des tendances, d’optimiser les opérations et de mieux comprendre les préférences des clients, conduisant ainsi à des décisions éclairées.

Quels outils sont couramment utilisés pour gérer le Big Data ?

Les outils couramment utilisés pour gérer le Big Data incluent Hadoop, Spark, et des solutions cloud comme AWS ou Google Cloud. Ces outils permettent aux entreprises de stocker, traiter et analyser efficacement de grandes quantités de données tout en assurant des performances optimales.

Pourquoi la véracité est-elle si importante dans le Big Data ?

La véracité est importante dans le Big Data car elle détermine la confiance que les entreprises peuvent accorder aux données analysées. Des données inexactes ou biaisées peuvent conduire à de mauvaises décisions, d’où la nécessité de mettre en place des processus de validation et de nettoyage des données pour garantir leur fiabilité.

Je suis professeur d’informatique depuis une bonne trentaine d’années et enseigne en lycées et écoles supérieures. Je partage quelques informations relatives à ma passion ainsi qu’aux sujets de la formation des jeunes.